Quer informações do Chapadensenews.com.br pelo celular?

Link de acesso:

https://chat.whatsapp.com/EcjdxwK4hNoL3ekYjD3MJL

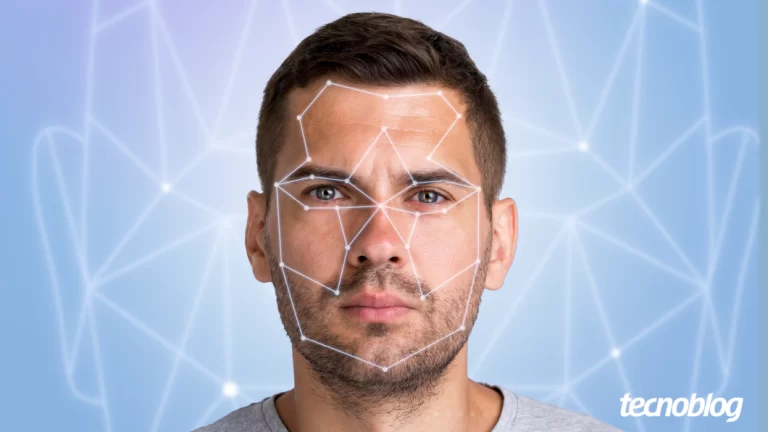

Já pensou ver o seu rosto em um vídeo totalmente aleatório? Ou ouvir sua própria voz dizendo coisas que jamais diria? Bom, isso é possível com uma tecnologia chama deepfake, que permite essa manipulação, principalmente em vídeos, de uma forma bastante convincente. Veja abaixo mais detalhes do que é um deepfake e por que é preciso se preocupar com essa técnica.

Deepfake usa Inteligência Artificial para trocar o rosto de pessoas em vídeos, sincronizar movimentos labiais, expressões e demais detalhes, em alguns casos com resultados impressionantes e bem convincentes.

Essa onda de trocar rostos de pessoas em vídeos não é nova. Mas, em dezembro de 2017, um usuário do Reddit, chamado deepfakes, deu um passo além. Com ferramentas de Inteligência Artificial e Aprendizado de Máquina de código aberto, como Keras e TensorFlow (este último, do Google), ele criou um algoritmo para treinar uma Rede Neural a mapear o rosto de uma pessoa no corpo de outra, frame por frame.

Ao invés de depender de edição manual como antigamente, o usuário, através da ferramenta (que recebeu o nome de Deepfake), precisa apenas de uma fonte para reconhecer o modelo do rosto da “vítima”, mapear a estrutura da cabeça destino e fazer a sobreposição. O software consegue ajustar a movimentação do vídeo original ao novo rosto e isso inclui expressões faciais e movimentos labiais.

No início, o Deepfake exigia conhecimentos avançados por parte do usuário, mas quando outros criaram aplicativos e sistemas capazes de automatizar todo o processo, a ferramenta foi massivamente usada para o mal: logo começaram a surgir dezenas de vídeos adultos editados com o software, com o rosto de atrizes e artistas.

A “brincadeira” do Deepfake não se limitou a vídeos adultos, no entanto: há uma série de criações que colocam rostos de celebridades em filmes nos quais não estiveram presentes. Entretanto, as possibilidades de uso do software são inúmeras e necessário dizer, nocivas. Até Mark Zuckerberg foi alvo de um vídeo falso.

Alguns exemplos de ferramentas de deepfake com fácil acesso são: o aplicativo Reface; os sites DeepSwap e DeepFakes Web; e os programas FaceApp e DeepFaceLab.

Importante destacar que deepfake é diferente de shallowfake. Na verdade, a premissa é a mesma, mas a diferença está na qualidade. No shallowfake a qualidade da manipulação é inferior, facilitando a identificação.

Os tipos de deepfake

Por mais que o foco do deepfake seja a troca de rosto em vídeos, engana-se quem pensa que a prática se restringe a isso. A técnica também é utilizada para a manipulação de áudios, onde podem ser criadas gravações que simulam a voz de determinada pessoa, tipo de deepfake facilmente compartilhável em mensageiros como o WhatsApp.

Além disso, já podemos nos deparar com os deepfakes textuais, com máquinas de escrita gerada por inteligência artificial; deepfakes nas redes sociais, para a criação de perfis falsos na internet; e os deepfakes em tempo real, em que é possível mudar o rosto em transmissões ao vivo, técnica permitida pelo software DeepFaceLive, por exemplo.

Potenciais riscos dos deepfakes

Ainda que o alvo principal da comunidade em torno da ferramenta sejam pessoas públicas, nada impede que alguém realmente mal-intencionado pegue um vídeo de uma pessoa comum e o coloque em uma situação constrangedora.

Não pense apenas em vídeos de porn revenge editados: é possível, por exemplo, forjar um momento de descontração entre amigos para criar um álibi, um depoimento para convencer outros de que você defende um determinado ponto de vista ou mesmo uma situação de crime, de modo a incriminá-lo. Tudo depende da criatividade do editor e de quantos vídeos seus estão disponíveis facilmente na internet.

Como a qualidade média dos vídeos não é muito alta, dadas as exigências de hardware (é preciso no mínimo uma GeForce GTX 1050 para resultados aceitáveis), tais criações chegam a ser bem convincentes a um desavisado, que pensará se tratar de um vídeo real, ainda que eles possuam uma falha. (https://tecnoblog.net/)